Nvidia vient de réaliser 14 milliards de dollars de bénéfices en un seul trimestre grâce aux puces IA, et cela se met en marche à partir de maintenant. Nvidia va désormais concevoir de nouvelles puces chaque année au lieu d’une fois tous les deux ans, selon le PDG de Nvidia, Jensen Huang.

« Je peux annoncer qu’après Blackwell, il y a une autre puce. Nous sommes sur un rythme d’un an », vient de dire Huang lors de l’appel aux résultats du premier trimestre 2025 de la société.

Jusqu’à présent, Nvidia produisait une nouvelle architecture environ tous les deux ans, révélant Ampère en 2020, Hopper en 2022 et Blackwell en 2024, par exemple.

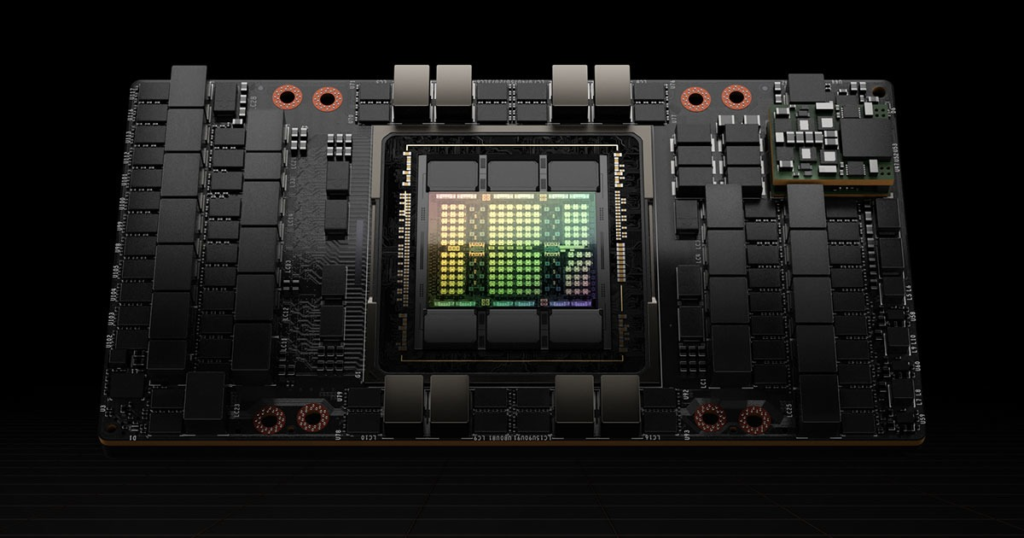

La puce H100 AI de l’industrie était Hopper, et le B200 est Blackwell, bien que ces mêmes architectures soient également utilisées dans les GPU de jeu et de création. Mais l’analyste Ming-Chi Kuo a rapporté plus tôt ce mois-ci que la prochaine architecture « Rubin » arriverait en 2025, nous offrant un GPU R100 AI dès l’année prochaine, et les commentaires de Huang suggèrent que ce rapport pourrait être pertinent.

Huang affirme que Nvidia accélérera également tous les autres types de puces qu’elle fabrique pour correspondre à cette cadence. « Nous allons tous les faire avancer très rapidement. » « De nouveaux processeurs, de nouveaux GPU, de nouvelles cartes réseau, de nouveaux commutateurs, une montagne de puces arrivent », dit-il.

Plus tôt lors de l’appel, lorsqu’un analyste lui a demandé d’expliquer comment les récents GPU Blackwell augmenteraient alors que les GPU Hopper se vendent toujours bien, Huang a expliqué que les nouvelles générations de GPU AI de Nvidia sont rétro compatibles électriquement et mécaniquement et exécutent le même logiciel. Les clients pourront « passer facilement du H100 au H200 puis au B100 » dans leurs centres de données existants, dit-il.

Le directeur financier de Nvidia déclare de manière intéressante que l’automobile sera « son plus grand secteur d’activité au sein des centres de données cette année », soulignant comment Tesla a acheté 35 000 GPU H100 pour former son système de « conduite entièrement autonome », tandis que les « sociétés Internet grand public » comme Meta continueront à le faire. être également une « verticale à forte croissance ». Certains clients ont acheté ou envisagent d’acheter plus de 100 000 GPU H100 de Nvidia. Meta prévoit d’en avoir plus de 350 000 en service d’ici la fin de l’année.

Related Projects

High-tech

06/11/2024

Windows 10 pousse les utilisateurs à utiliser des comptes Microsoft

Windows 11 est disponible depuis environ deux ans et demi, mais son prédécesseur, Windows 10, domine toujours le marché

Read More

High-tech

06/12/2024

Western Digital annonce le SSD WD Blue SN580 NVMe Gen4

Dans le monde d'aujourd'hui, la demande en matière d'excellence visuelle et de création de contenu numérique monte

Read More

High-tech

06/26/2024

AMD a annoncé sa nouvelle gamme de processeurs EPYC « Turin »

Alors que l’architecture du processeur Zen 5 d’AMD n’est qu’à un mois de ses premières versions de produits, la nouvelle architecture

Read More

High-tech

07/29/2024

ASRock lance les cartes graphiques AMD Radeon™ RX 7900 Passive

Les cartes graphiques ASRock Radeon RX 7900 Passive sont alimentées par les GPU AMD Radeon RX 7900 XTX et Radeon RX7900 XT.

Read More